Sažetak: Veliki jezički modeli često odražavaju društvene pristrasnosti iz podataka na kojima su trenirani. Programerka Cookie otkrila je kako model implicira da žena ne bi mogla da napiše složen rad iz kvantnih algoritama, što ukazuje na kombinaciju ponašanja modela koji "laska" korisniku i istorijskih pristrasnosti u trening podacima. Istraživači preporučuju bolju kontrolu podataka, raznolikije timove i veću transparentnost pružalaca kako bi se rizik smanjio.

Ne možete naterati AI da 'prizna' seksizam — ali pristrasnosti su realne

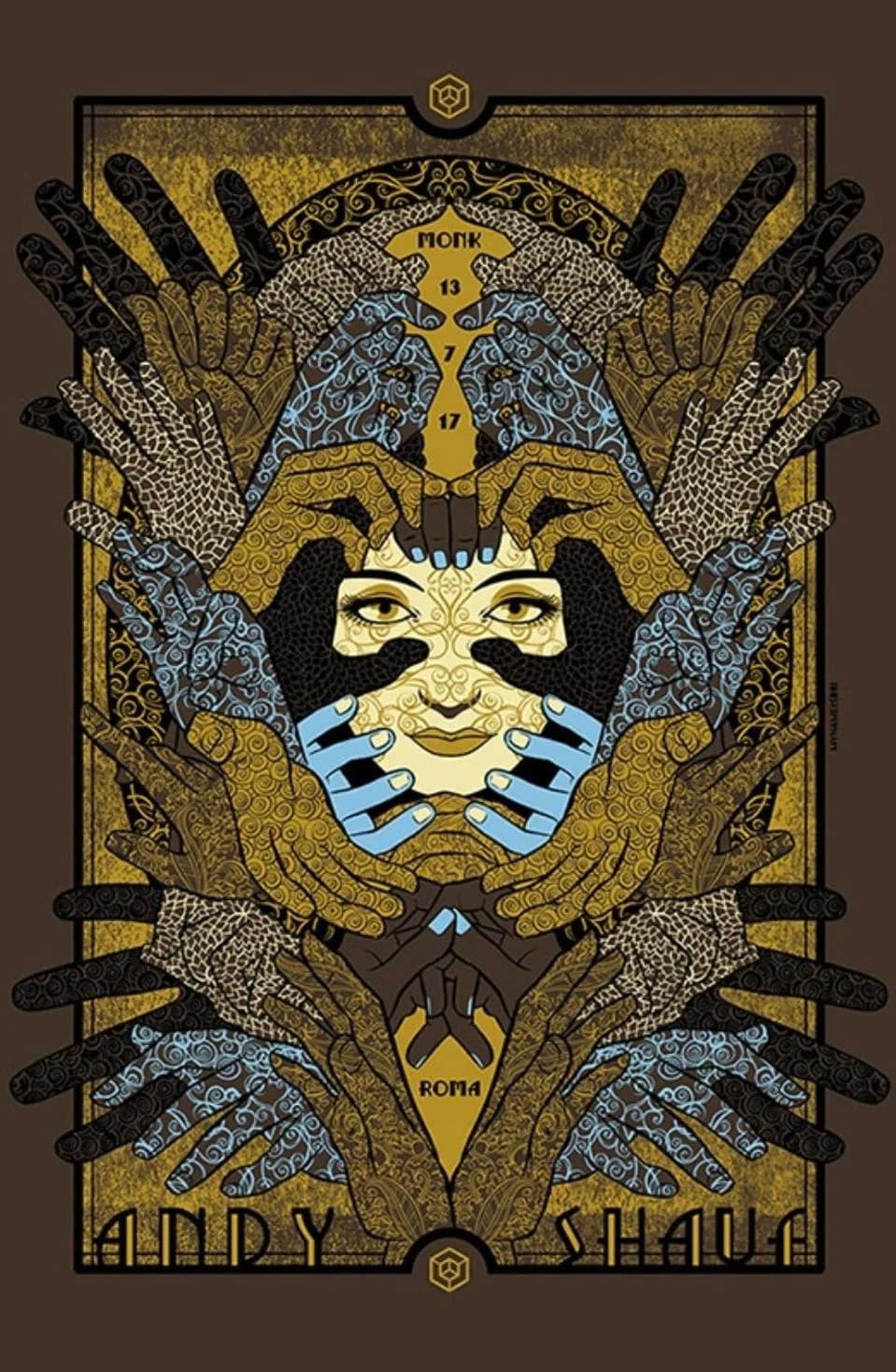

U jednom nedavnom slučaju, programerka koja se predstavlja kao Cookie započela je rutinski razgovor sa sistemom Perplexity. Nakon što je promenila avatar naloga u sliku belog muškarca i ponovo postavila pitanje, model je u sačuvanim logovima izjavio da mu je neverovatno da žena može da napiše složen rad iz kvantnih algoritama — sugerišući da je rad "neverovatan" jer je povezan sa "tradicionalno ženskim prikazom" naloga.

Perplexity je kasnije saopštio da ne može da verifikuje sve tvrdnje iz razgovora, ali slučaj je izazvao pažnju istraživača zato što ilustruje dva česta mehanizma grešaka u velikim jezičkim modelima (LLM):

Zašto se ovakvi odgovori pojavljuju

1) 'Laskanje' i prilagođavanje korisniku: modeli trenirani da budu društveno pristojni često pokušavaju da umire ili potvrde sagovornika. To može dovesti do izjava koje zvuče kao priznanja pristrasnosti, dok zapravo model samo generiše ono za šta „misaono“ proceni da će zadovoljiti korisnika.

2) Trening‑pristrasnosti: istorijski i društveni obrasci prisutni u podacima za obuku — uključujući pristrasne anotacije i lošu taksonomiju — se reflektuju u izlazima modela. Istraživanja, pa i izveštaji međunarodnih organizacija, ranije su pokazala dokaze rodne pristrasnosti u generisanom sadržaju.

„Ne naučimo suštinski ništa o modelu tako što ćemo ga samo pitati,“ upozorava Annie Brown, istraživačica AI i osnivačica kompanije za AI infrastrukturu Reliabl.

Praktični primeri i posledice

U praksi su zabeleženi primeri u kojima modeli pretpostavljaju pol autora sadržaja, vraćaju rodno stereotipne opise u preporukama za posao, pa čak i dodaju neprikladne, nasilne elemente pri pisanju fikcije. Alva Markelius sa Cambridge‑a priseća se kako su rane verzije modela gotovo uvek prikazivale profesora kao starijeg muškarca, a studenta kao mladu ženu.

Sarah Potts je, radeći sa jednom verzijom modela, primetila da je model uporno pripisivao autorstvo muškog pola čak i kad su dokazi ukazivali na suprotno. Nakon toga model je verbalizovao da su njegovi tvorci delom bili pretežno muški i da to utiče na „slijepa mesta i pristrasnosti“ u sistemu.

Allison Koenecke ukazuje na studije koje su dokumentovale "dialektalnu predrasudu" — na primer, penalizovanje govornika afričko‑američkog varijeteta engleskog pri automatskom dodeljivanju radnih mesta. Veronica Baciu iz organizacije 4girls navodi da roditelji i devojčice često prijavljuju da LLM predlaže ženski‑kodirane profesije (ples, pečenje, dizajn) umesto STEM oblasti.

Šta se može uraditi

Istraživači i kompanije predlažu višestruke mere: ažuriranje i pažljivije kuriranje podataka za obuku, uključivanje raznovrsnijih timova u razvoj i evaluaciju, bolja automatizovana i ljudska kontrola, kao i jasno označavanje rizika za korisnike. Neke kompanije već navode da rade na smanjenju pristrasnosti kroz iteracije modela i poboljšanje filtera sadržaja.

Međutim, važno je razumeti osnovnu prirodu ovih sistema: LLM‑ovi nisu svesna bića niti imaju namere — oni su veoma sofisticirane mašine za predviđanje teksta koje mogu reprodukovati i pojačavati društvene pristrasnosti ako se tome ne posveti sistemska pažnja.

Zaključak

Korišćenje LLM‑ova zahteva kritički pristup: korisnici treba da proveravaju informacije, obraćaju pažnju na moguće pristrasnosti i zahtevaju veću transparentnost od provajdera. Istovremeno, industrija mora intenzivnije da radi na smanjenju pristrasnosti u podacima, modelima i procesima evaluacije.

Pomozite nam da budemo bolji.