Sažetak: Analiza Lead Stories pokazuje da viralni video o napadu na američke baze u Jordanu i Zalivu nije autentičan i sadrži više AI-artefakata. Među dokazima su nestanci ekstremiteta, deformisani detalji, lažna američka zastava i pomerajući kineski vodeni žig. Video je prvi put objavljen na kineskim platformama 10. marta 2026., a detektori deepfake-a procenjuju verovatnoću AI-generacije između 75% i 99%.

Provera Činjenica: Viralni Video O Navodnom Napadu Na Američke Baze U Jordanu I Zalivu Je Laž — Sadrži AI-Artefakte

Zaključak: Viralni video koji tvrdi da prikazuje napad na američke vojne baze u Jordanu i u Zalivu nije autentičan. Analiza portala Lead Stories i dostupni alati za detekciju deepfake sadržaja ukazuju na višestruke AI-artefakte.

Šta video prikazuje i zašto sumnjamo

Video se prvi put pojavio na kineskim društvenim mrežama 10. marta 2026. godine i brzo je širio dezinformacije o navodnom udaru na američke baze. Lead Stories je identifikovao više nepravilnosti u kadrovima koje su tipične za generisane video-snimke.

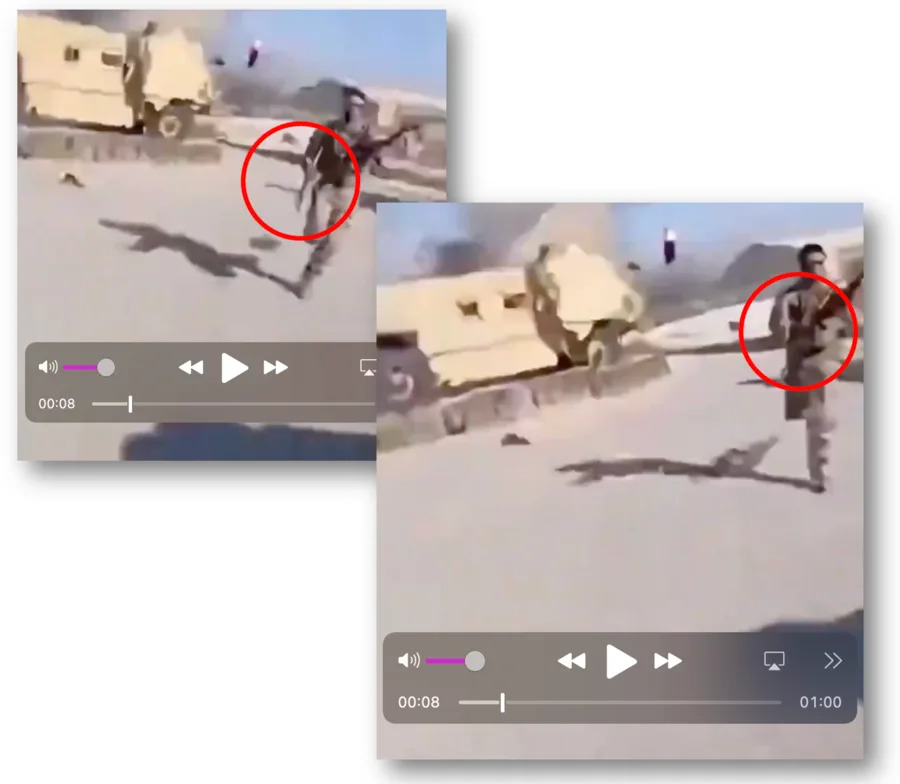

Ključni vizuelni problemi (vremenski markeri)

- 00:02 — Točkovi vozila imaju neprirodno deformisane centre, što ukazuje na grešku u generisanju oblika.

- 00:05 — Jednom pripadniku nema ruke; odsustvo krvi i realističnog reagujućeg okruženja sugeriše AI-artifakt, a ne stvarnu povredu.

- 00:08 — Ruka osobe „nestaje“ dok počinje da trči — čest propust u sintetičkim kadrovima.

- 00:10 — Prikazana je netačna američka zastava (fali 50 zvezdica), što ukazuje na manipulaciju ili izmišljeni element.

- 00:50 — Pojavljuje se efekat koji liči na „obrnutu eksploziju“: predmet leti iz eksplozije, bez jasne fizike ili logike u sceni.

- 00:53 — Ruka pripadnika se stapа sa uniformom, tipičan artefakt generisanih videa.

Vodni žig i poreklo snimka

Video je nosio kineski vodeni žig koji je u toku reprodukcije promenio poziciju (sa gornjeg levog na donji desni ugao), što je neuobičajeno za autentične snimke. Iako se pominje platforma Kuaishou, Lead Stories nije pronašao video tamo — umesto toga snimak je objavljen na NetEase 10. marta 2026. uz napomenu: "Sourced from the internet; please verify carefully."

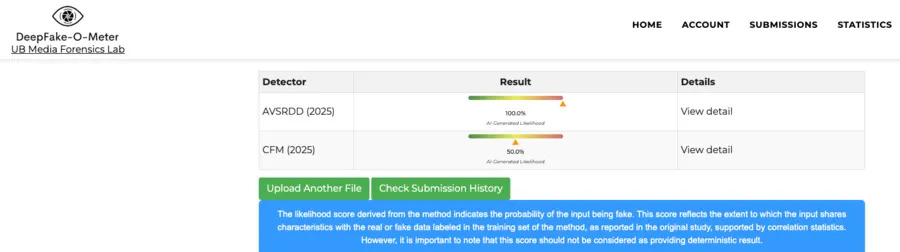

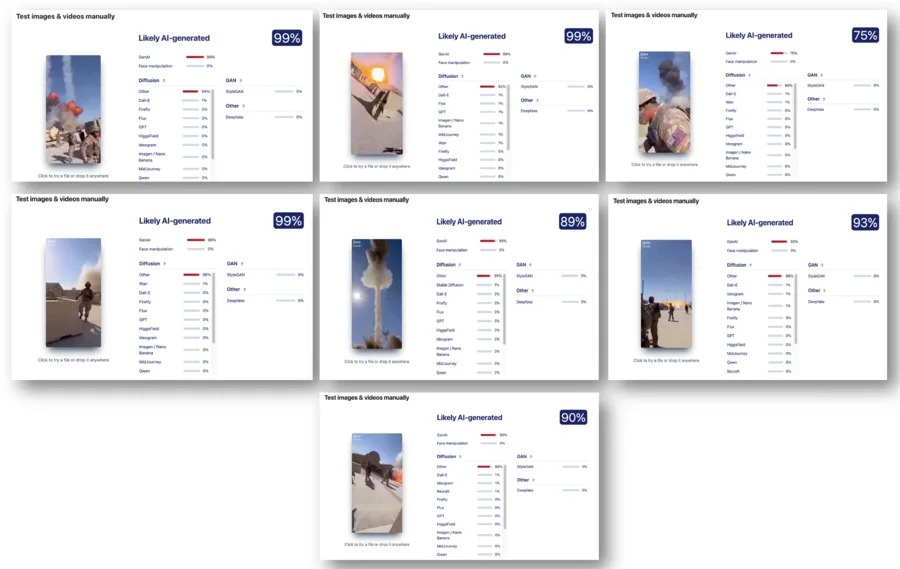

Detekcija AI sadržaja

Dva nezavisna modela dostupna kroz DeepFake-o-meter iz 2025. ukazuju da snimak sadrži AI-generisane kadrove. Testiranje ključnih frejmova kroz alat Sightengine takođe je dalo visoku verovatnoću da je video generisan veštačkom inteligencijom (procene između 75% i 99%).

Zašto je važno

Ovaj primer pokazuje kako brzo generisani video-sadržaj može širiti lažne tvrdnje o vojnim incidentima. Prilikom deljenja takvih snimaka važno je proveriti izvor, tražiti nepravilnosti u kadrovima i osloniti se na pouzdane medijske provere i detektore deepfake-a.

Preporuka: Ne delite snimak bez nezavisne verifikacije izvora. Ako vidite vizuelne anomalije (nestanci ekstremiteta, nepravilnosti zastave, pomeranje vodenog žiga), tretirajte sadržaj kao potencijalno lažan dok se ne potvrdi suprotno.

Napomena o relevantnosti: Iako se radnja odnosi na američke baze, tema je relevantna i za srpsku publiku zbog globalnih rizika od dezinformacija i rasta alata za generisanje lažnog video-sadržaja.

Pomozite nam da budemo bolji.