Sažetak: Video koji navodno prikazuje pripadnike IRGC u školskom dvorištu nije autentičan ratni snimak. Analize pokazuju da je klip nastao generativnom AI preradom statične fotografije objavljene 8. januara 2026. Alati za detekciju (npr. hivemoderation.com) dali su visoke procene verovatnoće za AI, a nezavisni analitičari su uočili vizuelne greške poput iskrivljene kapije i lažnih "žica" u kadru.

Fakt-ček: Video iz školskog dvorišta nije dokaz da su pripadnici IRGC bombardovani — to je AI „motionizovana“ fotografija

Video koji kruži društvenim mrežama i navodno prikazuje pripadnike Iranske revolucionarne garde (IRGC) kako se „skrivaju u školama” nije autentičan snimak bombardovanja. Istraga pokazuje da je klip nastao generativnom veštačkom inteligencijom preradom stare fotografije, a ne iz originalnog vojnog snimka.

Šta se tvrdi

U objavi na X platformi od 15. marta 2026. nalazi se snimak uz poruku:

IRGC Hiding in schools thinking Israel won't bomb them. Doesn't matter, you'll still be killed.Autori objave predstavljaju video kao dokaz da su članovi IRGC-a bili meta udara.

Kako je provereno

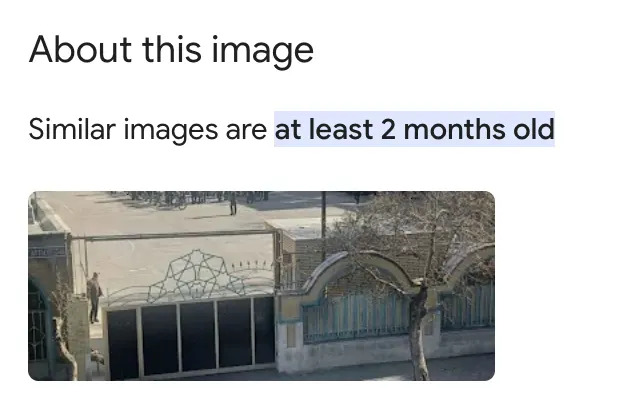

Obrnuta pretraga slike pokazala je da je ista statična fotografija objavljena ranije — stranice sa tom fotografijom pojavile su se 8. januara 2026. To znači da fotografija potiče pre napada SAD i Izraela na Iran 28. februara 2026. Googleova funkcija "About this image" takođe je navela da je slika stara najmanje dva meseca u trenutku pregleda.

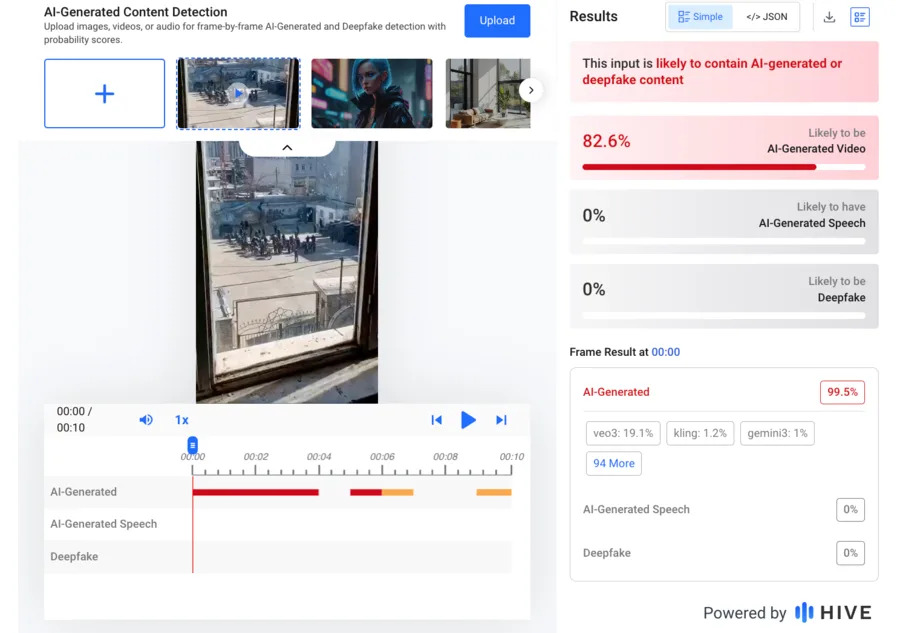

Lead Stories je testirao video pomoću alata hivemoderation.com za detekciju AI-sadržaja i dobio je rezultat od 82,6% verovatnoće da sadrži elemente generisane veštačkom inteligencijom. Dodatni testovi u alatu DeepFake-o-meter, koristeći aktuelne modele iz 2025, dali su opseg verovatnoće od 37,5% do 100%.

Vizuelni dokazi da je reč o AI

Upoređivanje statične fotografije i video-klipa otkriva jasno vidljive anomalije koje ukazuju na "motionizaciju" (pretvaranje slike u video pomoću AI):

- Obris prednje kapije u videu je iskrivljen i menja se bez logičnog razloga, čak i pre pojave dima.

- Senke prisutne na originalnoj fotografiji u videu deluju kao slomljene žice — element koji nije na originalu.

- Sve osobe stoje u identičnim pozicijama kao na staroj fotografiji, što ukazuje da su pokreti generisani nad statičnim kadrom.

OSINT analitičar i edukator za medijsku pismenost Tal Hagin prvi je primetio da su "sve osobe tačno u istim pozicijama kao na staroj slici" i da je "AI pogrešio sa prednjom kapijom, dodajući/uklanjajući elemente koji nisu prisutni na pravom školskom kapiji".

Zaključak i preporuka

Video nije stvarno snimljen tokom sukoba — to je AI-generisan klip napravljen iz prethodno objavljene fotografije (objavljene 8. januara 2026.), što ga diskvalifikuje kao dokaz o bombardovanju nakon 28. februara 2026. Pre deljenja takvog sadržaja savetujemo proveru izvora, analizu metapodataka i upotrebu alata za detekciju AI-sadržaja.

Ne delite neproverene snimke — pogotovo u situacijama oružanih sukoba, gde dezinformacije mogu imati teške posledice.

Pomozite nam da budemo bolji.