Kratko: Javnost je zabrinuta zbog AI, ali tehnologija ima veliki potencijal da ubrza naučna otkrića i ponovo podstakne ekonomski rast. Projekti poput AlphaFold, GNoME i GraphCast već pokazuju konkretne primene u biologiji, materijalima i meteorologiji. Agentni sistemi kao što su Coscientist i FutureHouse-ovi alati mogu čitati literaturu, planirati eksperimente i podržati laboratorijske radove, ali su odgovarajuće kontrole i etika od presudnog značaja.

Ponestaje Nam Dobrih Ideja — Kako AI Može Pomoći Da Ih Pronađemo i Ponovo Pokrenemo Rast

Ameriko, jasno ste rekli: AI vam ne uliva poverenje — i razumljivo je zašto. Ali iza javnog straha krije se drugačija priča: veštačka inteligencija može postati ključna infrastruktura koja ubrzava naučna otkrića i podstiče ekonomski rast.

Javnost, strahovi i kontradikcije

Prema istraživanju Pew Research Centra, 50% ispitanika više se brine nego raduje zbog AI, dok samo 10% oseća suprotno. U jednoj anketi samo 2% ispitanika u potpunosti veruje AI, a 60% delimično ili potpuno ne veruje njenim odlukama. Takav strah je razumljiv: slušamo optužbe da AI "krade" poslove, energiju, raspoloženje, pa i budućnost.

Zašto nam ponestaje ideja

Postoji rastući broj dokaza da je generisanje novih ideja otežano. Studija Nicholasa Blooma pokazala je da danas treba znatno više istraživača i ulaganja u R&D da bi se održala dosadašnja stopa rasta produktivnosti. Analiza iz Nature 2023 na 45 miliona radova i gotovo 4 miliona patenata ukazuje da je naučni rad postao manje disruptivan — ređe pokreće potpuno nove pravce.

Demografski trendovi (niže stope fertiliteta u bogatim zemljama i predviđeno platoa globalnog stanovništva) dodatno smanjuju broj potencijalnih inovatora, a restrikcije na priliv stranih talenata mogu dodatno blokirati proizvodnju ideja.

Gde AI može pomoći — i već pomaže

Jedno od glavnih uskih grla nauke je preterana količina podataka i literature koje nijedan istraživač ne može temeljno obraditi. Upravo to AI može rešiti — kao "ko-naučnik" koji čita, sažima, predlaže i pretražuje mogućnosti.

AlphaFold i biologija

AlphaFold (DeepMind) predvidelo je trodimenzionalne oblike proteina na osnovu amino-kiselinskih sekvenci — zadatak koji je ranije zahtevao mesece ili godine laboratorijskog rada. Danas postoje predviđanja za ogroman broj proteina, što ubrzava dizajn lekova, vakcina i enzima. Autori vezani za AlphaFold nagrađeni su Nobelovom nagradom za hemiju 2024.

Materijali i GNoME

DeepMind-ov GNoME predložio je oko 2,2 miliona novih anorganskih kristalnih struktura i označio ~380.000 kao verovatno stabilne — naspram ~48.000 tih struktura koje su bile potvrđene pre toga. To je eksponencijalno širenje prostora za pronalazak materijala za jeftinije baterije, efikasnije solarne ćelije i bolje čipove.

Meteorologija i GraphCast

GraphCast uči iz decenija podataka i može generisati globalnu 10-dnevnu prognozu za manje od minuta, često sa boljim rezultatima od tradicionalnih modela — što može unaprediti upozorenja na vremenske nepogode i planiranje zaštite infrastrukture.

AI Koji Pokreće Eksperimente

Neka AI rešenja već ne samo analiziraju, već i upravljaju eksperimentima. Coscientist (Carnegie Mellon) demonstrirao je da model može čitati dokumentaciju, planirati višestepene hemijske eksperimente, pisati kontrolni kod i upravljati laboratorijskim instrumentima u automatizovanom okruženju.

Neprofitna organizacija FutureHouse razvija agente — Crow, Falcon, Owl i Phoenix — koji rade preglede literature, proveravaju da li je neko već uradio određeno istraživanje i planiraju hemijske tokove rada. Njihov multiagentni sistem Robin kombinovao je ove alate u end-to-end tok rada i pomogao u identifikaciji kandidata za ponovnu upotrebu leka u istraživanju degeneracije makule, uz ljudsku verifikaciju i laboratorijsku realizaciju.

Šta ovo znači za ekonomiju i društvo

Ako globalni broj istraživača stagnira, AI za nauku može „povećati broj umova“ tako što čini svakog istraživača produktivnijim — što može dovesti do jeftinijeg otkrića lekova, boljih materijala za energetiku i pouzdanijih modela za klimu i prirodne nepogode.

Rizici i neophodne kontrole

Ipak, postoje ozbiljni rizici: jezički modeli mogu samouvereno pogrešno sažimati ili generalizovati naučne rezultate; alati koji ubrzavaju dizajn vakcina mogu olakšati i istraživanje štetnih patogena. Povezivanje AI sistema sa laboratorijskim uređajima bez jakih sigurnosnih i etičkih kontrola može skalirati i dobre i loše eksperimente brže nego što ljudi mogu da ih nadgledaju.

Zaključak

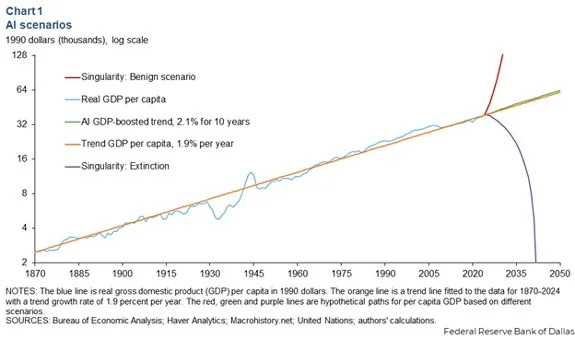

Strah javnosti pred opasnostima AI je realan i zahteva pažnju. Ali umesto da gledamo samo crvenu i ljubičastu ekstreme (singularnost ili izumiranje), postoji i treća, realističnija putanja: AI kao nevidljiva infrastruktura koja pomaže naučnicima da pronađu bolje ideje brže i time tiho poboljša zdravlje, energetiku, klimu i životni standard.

Serijal je podržan grantom Arnold Ventures. Vox je imao potpunu diskreciju nad sadržajem izveštavanja.

Pomozite nam da budemo bolji.