AI-generisani video-snimci sve češće obmanjuju i velike medijske kuće: Fox News je morao da ispravi priču o korisnicima SNAP-a nakon što su otkriveni AI-klipovi. Sličan problem primećen je i kod Yann LeCuna, koji je podelio sumnjiv video koji podseća na generisane sadržaje. Autori upozoravaju na manjak efikasnih zaštita od strane kompanija i regulatornih tela, dok političke figure mogu zloupotrebiti okrivljavanje „AI“-ja.

AI-falsifikati varaju medije i čak stručnjake — Fox News i Yann LeCun pod senkom lažnih snimaka

AI-falsifikati sve više obmanjuju medije i javnost

U poslednje vreme sve se češće beleže slučajevi u kojima veštački generisani video-snimci uspevaju da prevare velike redakcije i samu javnost. Jedan od najozbiljnijih primera dogodio se kada je Fox News objavio tekst u kome se tvrdilo da korisnici američkog programa pomoći za hranu — SNAP (Supplemental Nutrition Assistance Program) — navodno prete pljačkom prodavnica zbog mogućeg zastoja isplata. Nakon što su online komentatori ukazali da su neki od priloženih klipova verovatno generisani pomoću AI-alata, članak je izmenjen, a naslov i napomena urednika su ažurirani.

Newsmax je takođe preneo sličan materijal, što pokazuje da problem nije izolovan samo na jednu medijsku platformu.

Da li čak i stručnjaci podležu zabludi?

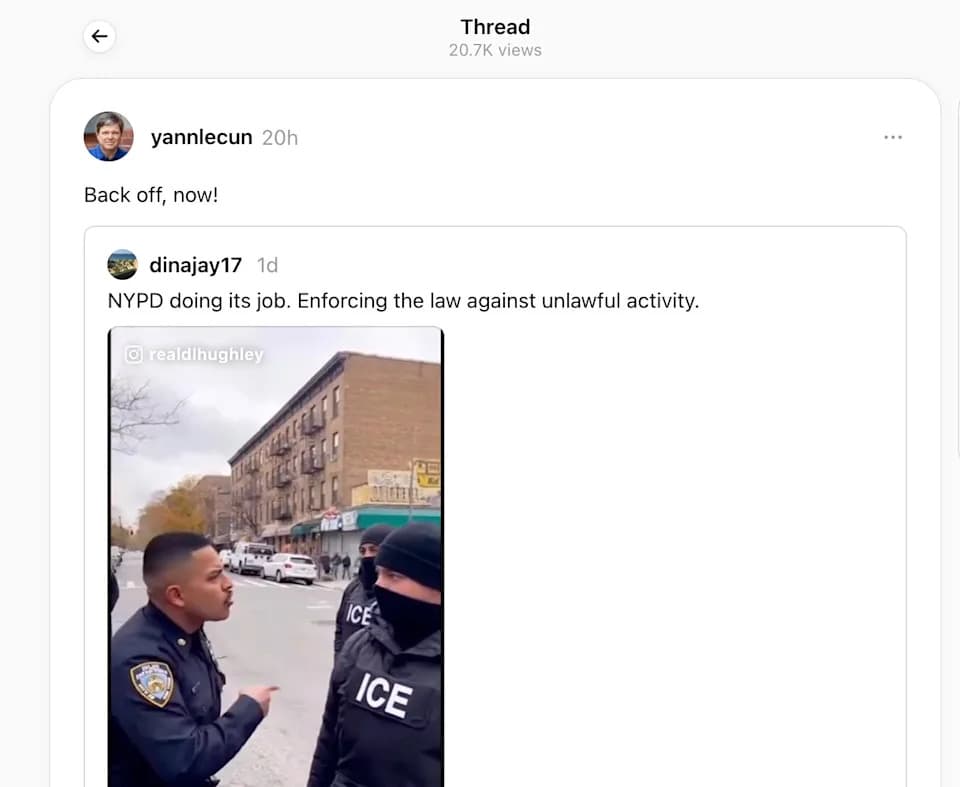

Na društvenim mrežama posebno je odjeknuo slučaj Yann LeCuna, glavnog AI-naučnika u Meti, koji je podelio video koji izgleda kao snimak sukoba između policajca i agenata ICE-a u Njujorku. Mnogi su ukazali da klip ima karakteristike tipične za AI-generisane sadržaje — kratko trajanje, ukočen govor i neprirodni prelazi. Neki su ocenili da bi takav snimak mogao biti napravljen u aplikacijama za generisanje videa, poput Sora.

Autori izveštaja su pokušali da kontaktiraju LeCuna; Meta je navodno odbila komentar, a LeCun nije odgovorio na upite. Nakon sugestija u komentarima da je u pitanju lažan klip, LeCun je objavio nejasan odgovor koji nije rasvetlio dvojbe.

Nedostatak efikasnih zaštita i političke implikacije

Do sada nijedna velika kompanija u AI sektoru nije uvela univerzalne i pouzdane mehanizme za automatsko označavanje ili blokiranje lažnih sadržaja, a vlasti u SAD nisu pokazale spremnost da brzo nametnu strože regulative. Sve to povećava rizik da će manipulativni snimci uticati na javno mnjenje i biti zloupotrebljeni u političke svrhe.

Primer zloupotrebe: Na jednoj konferenciji za novinare, bivši predsednik Donald Trump je rekao: „Ako se desi nešto zaista loše, samo okrivite AI.“ Ova izjava oslikava kako se mogućnost negiranja autentičnosti snimaka može koristiti kao odbrambeni ili manipulativni manevr.

Zaključak: Slučajevi Fox Newsa i Yann LeCuna pokazuju koliko je danas važno proveravati izvore, primenjivati osnovna pravila medijske pismenosti i zahtevati veću transparentnost od platformi. Potrebne su tehničke mere, jasnija pravila i kritičniji pristup urednika i publike kako bi se smanjio uticaj lažnih AI-sadržaja.

Pomozite nam da budemo bolji.