Studija Aalto univerziteta (februar 2026) pokazuje da korišćenje chatbota poput ChatGPT‑a izravnava Dunning–Krugerov efekat: svi korisnici skloniji su precenjivanju sopstvenih sposobnosti, a najAI‑pismeniji to čine najviše. Istraživanje na 500 ispitanika koji su rešavali LSAT zadatke ukazuje da spretnost prihvatanja prvog odgovora i "kognitivno prebacivanje" smanjuju metakognitivno praćenje. Autori predlažu da AI interfejsi aktivno podstiču proveru i daju pokazatelje poverenja kako bi se smanjili rizici.

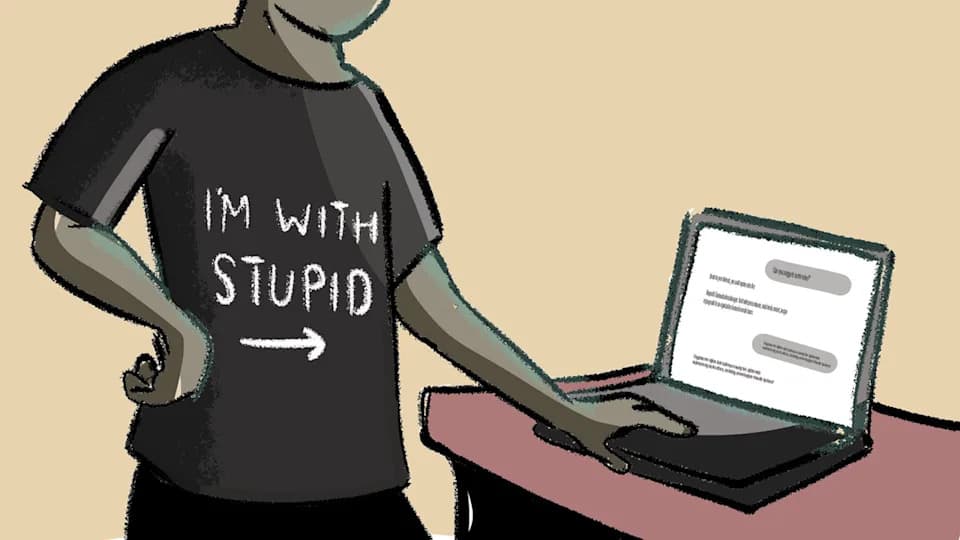

Nova studija: Korišćenje AI briše Dunning–Krugerov efekat — najAI‑pismeniji najviše precenjuju sebe

Sažetak istraživanja: Studija istraživača sa finskog Aalto univerziteta (u saradnji sa timovima iz Nemačke i Kanade), objavljena u februaru 2026. u časopisu Computers in Human Behavior, pokazuje da upotreba chatbota značajno menja način na koji ljudi procenjuju sopstvene sposobnosti: svi korisnici skloniji su precenjivanju, a najiskusniji korisnici AI-ja to čine najviše.

Šta su istraživači uradili?

Istraživanje je obuhvatilo 500 ispitanika kojima su postavljena logička pitanja iz testa za prijem na pravne fakultete (LSAT). Polovina učesnika je imala dozvolu da koristi popularni chatbot ChatGPT, dok druga polovina nije. Svi su potom popunjavali testove AI‑pismenosti i procenjivali sopstveni učinak; obe grupe su bile motivisane dodatnom nadoknadom za tačnu samoprocenu.

Glavni nalazi

1. Izravnavanje Dunning–Krugerovog efekta: Korišćenje AI smanjuje razliku između manje i više veštih učesnika — ali zato svi češće precenjuju svoje rezultate.

2. Veća precenjenost među AI‑pismenima: Najisksutveniji korisnici AI‑aleta pokazali su najveći porast samopouzdanja u odnosu na stvarni učinak.

3. Kognitivno „prebacivanje“ (cognitive offloading): Mnogi su prihvatali prvi predloženi odgovor od chatbota bez dublje provere ili dodatne refleksije, što smanjuje metakognitivno praćenje — sposobnost da procenimo kako i koliko dobro razmišljamo.

Značaj i potencijalne posledice

Autori upozoravaju na nekoliko rizika: pad metakognitivne preciznosti (manje tačna procena sopstvenih sposobnosti), povećana verovatnoća pogrešnih odluka zbog precenjivanja i dugoročno erodiranje veština provere informacija. Iako LLM modeli (veliki jezički modeli) mogu svima poboljšati performanse u određenoj meri, oslanjanje na njih bez kritičkog propitivanja može voditi ka površnijem razmišljanju.

"Umesto očekivane bolje procene sopstvenog rada, naši nalazi otkrivaju značajnu nesposobnost da se tačno proceni sopstveni učinak pri korišćenju AI, prisutnu jednako u čitavom uzorku," rekao je Robin Welsch, jedan od autora.

Preporuke

Istraživači predlažu promene u dizajnu interaktivnih AI sistema kako bi se poboljšalo metakognitivno praćenje: uključivanje mehanizama koji podstiču korisnika na kritičko preispitivanje (npr. pitanja poput „Koliko ste sigurni u ovaj odgovor?“ ili „Šta bi moglo nedostajati?“), uvođenje skorova poverenja i vidljivih indikatora pouzdanosti odgovora.

Studija takođe podržava preporuke institucija poput Royal Society da obuka za rad sa AI treba da obuhvati kritičko mišljenje i procenu rizika, a ne samo tehničku pismenost.

Zaključak

Kratkoročno, AI može poboljšati učinak u konkretnim zadacima. Međutim, bez namernog podsticanja refleksije i alata za proveru, postoji rizik da će širi i dublji metakognitivni kapaciteti opasti — ljudi će češće precenjivati svoje sposobnosti i donositi manje promišljene odluke.

Pomozite nam da budemo bolji.