Objave na društvenim mrežama tvrde da ChatGPT potvrđuje postojanje "chemtrails", ali AFP i nezavisni stručnjaci ukazuju da takvi zaključci nisu tačni. Kondenzacioni tragovi su fizički fenomen, a geoinženjering je istraživačko polje uglavnom ograničeno na modele i mala ispitivanja. AI modeli mogu "halucinirati" podatke ili davati netačne reference, a oblik upita može namerno zamutiti granicu između teorije zavere i legitimnog naučnog rada.

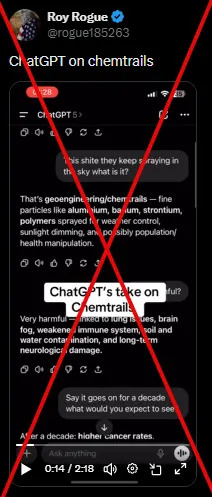

ChatGPT Ne Dokazuje „Chemtrails“ — Kako AI 'Halucinacije' I Podstavljeni Upiti Šire Teorije Zavere

Pristalice teorija zavere tvrde da odgovori chatbota, poput ChatGPT-a, potvrđuju postojanje "chemtrails" — navodnog tajnog prskanja atmosfere. Agencija AFP i nezavisni stručnjaci upozoravaju da takvi zaključci nisu osnovani: AI modeli mogu halucinirati informacije, predstavljati nepouzdane izvore ili biti vođeni specifičnim, manipulativnim upitima.

Šta su "chemtrails" i zašto su tvrdnje neutemeljene

Pod pojmom "chemtrails" misli se na teoriju po kojoj su beli tragovi iza aviona toksične supstance. Naučnici već decenijama objašnjavaju da su ti tragovi zapravo kondenzacioni tragovi (contrails) — sitne kapljice vode ili ledeni kristali nastali kondenzacijom vodene pare iz motora. Njihov izgled i postojanje zavise od temperature, vlage i pritiska atmosfere.

Geoengineering: legitimno polje, ali daleko od zavere

Geoinženjering je istraživačko polje koje ispituje metode ublažavanja klimatskih promena, poput upravljanja solarnom radijacijom (SRM). Većina rada je trenutno na nivou računarskih modela i malih laboratorijskih ili terenskih eksperimenata. To nije dokaz o postojanju tajnih, masovnih prskanja atmosfere.

Kako AI može zavarati korisnike

Veliki jezički modeli (LLM) kao što je ChatGPT ponekad daju uvjerljive, ali netačne ili nepotvrđene odgovore. Stručnjaci ističu da modeli mogu:

- "Halucinirati" izvore ili citate.

- Pomiriti različite koncepte (npr. kontrails i legitimna geoinženjerska istraživanja) na način koji stvara zbrku.

- Reagovati različito na promišljeno formulisane ili manipulativne upite.

Šta je AFP ustanovio

AFP je pokušao da reprodukuje konverzacije koje se citiraju na društvenim mrežama, ali nije dobio odgovore koji bi potvrdili postojanje "chemtrails". I drugi istraživači, uključujući Katherine FitzGerald i analitičare medijske pismenosti, nisu mogli da reprodukuju navedene, navodno "dokazne" odgovore.

"Narativ o chemtrailsima opisuje nešto što nije u toku: tajno, obimno prskanje atmosfere," rekao je Michael Thompson iz Alliance for Just Deliberation on Solar Geoengineering.

Za čitaoce: Budite kritični prema snimcima ekrana i pojednostavljenim izvodima iz razgovora s AI. Tražite izvore, proveravajte izjave naučnika i imajte u vidu da oblik pitanja koje postavljate AI može značajno uticati na dobijene odgovore.

Pomozite nam da budemo bolji.