Deepfake video oglasi koje proizvodi veštačka inteligencija već utiču na predizbornu kampanju za srednje izbore u SAD 2026. godine, posebno u oglasima koje plasiraju republikanske grupe. Savezna regulativa izostaje

AI Deepfakeovi Zamagljuju Realnost U Predizbornoj Kampanji Za Srednje Izbore 2026. U SAD

Autori: Joseph Ax i Helen Coster | New York, 28. mart

Kada se video otvori, demokratski predstavnik iz Teksasa James Talarico deluje kao da stoji ispred državne zastave i široko se smeši dok u kameru izgovara: „Radikalizovani beli muškarci su najveća domaća teroristička pretnja u našoj zemlji.“ U trenutku kada se izgovara izraz „beli muškarci“, čuje se i prigušeni šapat: „tako je. tako je.“

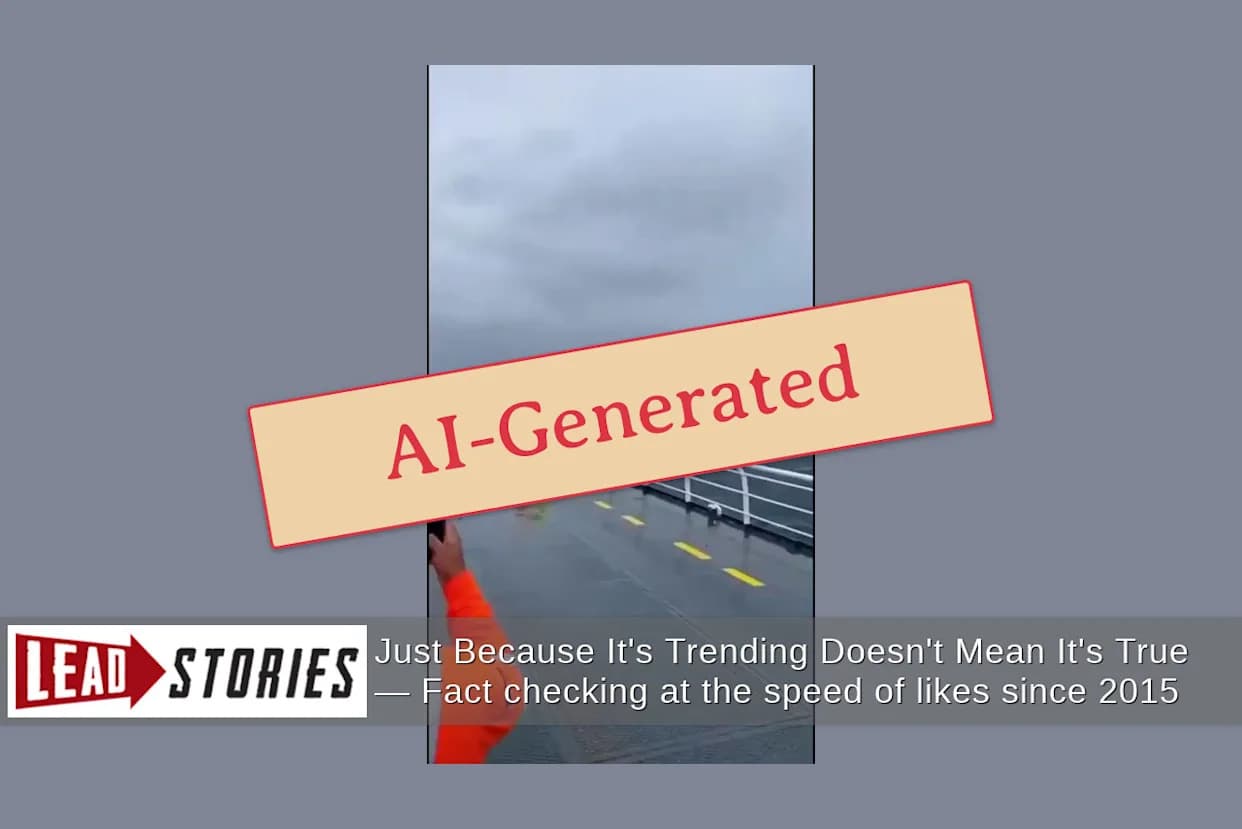

Međutim, Talarico nikada nije snimao taj snimak. Radi se o reklami generisanoj veštačkom inteligencijom (AI) koju je objavio National Republican Senatorial Committee (NRSC), u kojoj je kompjuterski izmenjena Talaricova pojava i glas kako bi ponovio stare objave sa društvenih mreža. Natpis "AI generated" pojavljuje se malim fontom u donjem desnom uglu i lako može proći neprimećeno.

Šta se dešava u kampanji

Ovaj realistični video jedan je od novog talasa "deepfake" oglasa koje kampanje već koriste pred novembarske srednje izbore 2026. Alati za generisanje sadržaja pomoću AI napreduju velikom brzinom i postaju pristupačniji, pa ih koriste i nacionalne stranačke organizacije i manji timovi za lokalne izbore.

Rizici i efikasnost

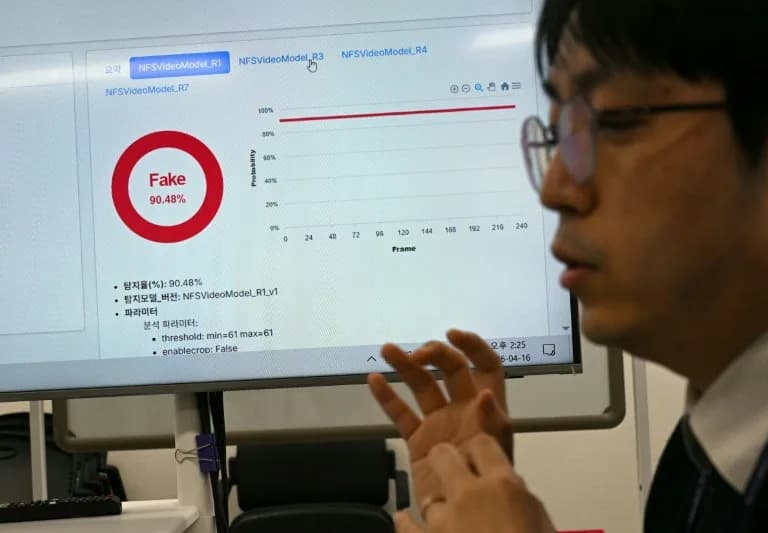

Stručnjaci za politiku i istraživači upozoravaju da deepfakeovi mogu zbuniti i obmanuti birače, dodatno potkopavajući poverenje u izborne procese i institucije. Studija iz 2025. objavljena u recenziranom Journal of Creative Communications pokazala je da ljudi teško prepoznaju deepfake videe i da to utiče na njihovo mišljenje.

Politički stratezi ističu da su AI‑generisani video materijali često jeftiniji i brži za proizvodnju, a vizuelni format ih čini lako deljivim na društvenim mrežama. Mogu se koristiti i za satiru, ali granica između satire i obmane često je tanka.

Primeri iz 2026. kampanje

Reutersova revizija oglasa i izjave stručnjaka ukazuju da republikanske grupe ove sezone češće koriste deepfake tehnologiju od demokrata. Pored Talarica, zabeleženi su i drugi primjeri:

- Kampanja kongresmena Majka Collinsa iz Džordžije objavila je deepfake u kojem senator Jon Ossoff izgleda kao da kaže da nije upoznat sa poslom farmera osim preko Instagrama.

- Republikanski odbor okruga Loudoun objavio je AI‑generisane napade protiv guvernerke Abigail Spanberger.

- U Teksasu su se pojavili satirični i napadački AI oglasi u razmeni između kampanja Kena Paxtona i Johna Cornyna.

NRSC je branio oglas navodeći da predstavljeni sadržaj sadrži Talaricove sopstvene ranije objave. Talaricova kampanja odgovara da protivnici koriste deepfakeove da bi zavarali birače.

Pravna i medijska praznina

Na saveznom nivou u SAD trenutno ne postoji celovita regulativa koja bi ograničila upotrebu AI u političkom oglašavanju. Umesto toga, usledila je patchwork politika država: 28 saveznih država donelo je zakone koji se uglavnom fokusiraju na obaveštavanje o upotrebi AI, ali ti propisi imaju ograničenja i često se odnose samo na formalne političke kampanje, a ne na korisnike društvenih mreža.

Društvene mreže, kao što su Meta i X, povremeno označavaju AI‑generisan sadržaj, ali su smanjile profesionalno fact‑checking uređivanje i više se oslanjaju na korisničke napomene, što dodatno komplikuje borbu protiv dezinformacija.

Zašto je važno

Stručnjaci upozoravaju da normalizacija upotrebe deepfakeova u kampanjama može dugoročno narušiti poverenje javnosti u informacije i institucije, otežati pravilno informisanje birača i pojačati polarizaciju. Istovremeno, tehnologija nudi i legitimne mogućnosti za kreativnu politiku i satiru, pod uslovom da se koriste transparentno i etički.

"Šteta koju možemo naneti rigoroznosti i kredibilitetu izbora i demokratskih sistema vrlo lako može biti pojačana", rekao je Daniel Schiff, profesor sa Purdue univerziteta koji proučava deepfakeove.

(Izveštavali: Helen Coster i Joseph Ax; uredili: Ross Colvin i Alistair Bell)

Pomozite nam da budemo bolji.